AmazonがAnthropicに330億ドルを投資 その規模と構造を読み解く

2026年4月20日、AmazonがAnthropicへの追加出資を正式発表しました。即時出資額は50億ドル(約7,900億円)、マイルストーン達成次第でさらに最大200億ドルが追加される条件付き構成です。これにより、過去の累計出資80億ドルと合わせた最大出資総額は330億ドル(約5.2兆円)に達します。

AIの基盤モデル競争が激化する中、これほどの規模の出資は前例がほとんどありません。しかし注目すべきは単なる金額の大きさではなく、この契約が示す「AWSとAnthropicの相互依存の深化」という構造です。本記事では、AWS・Claude APIを日常的に使うエンジニアの視点から、この提携の実態と技術戦略上の意味を整理します。

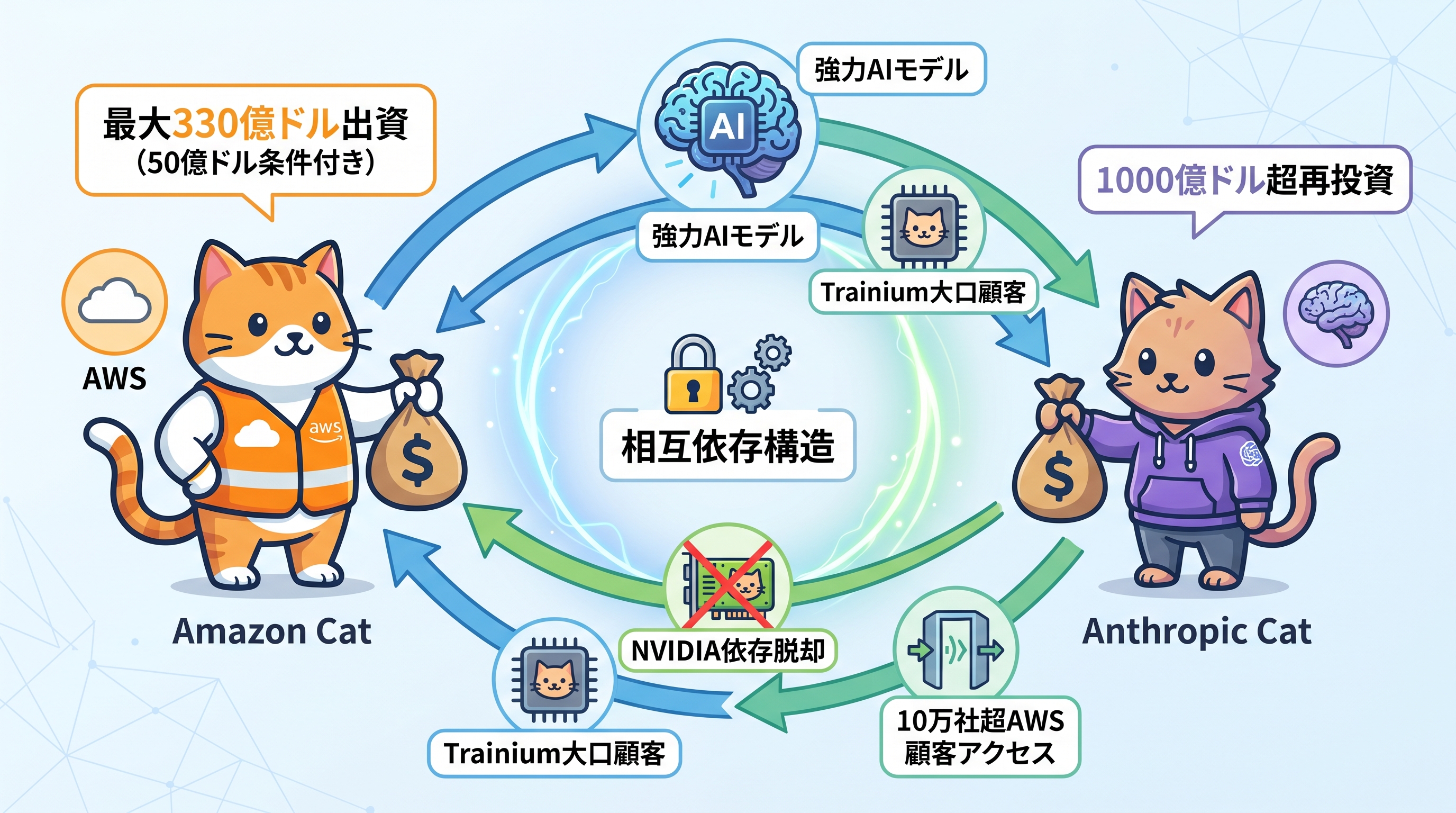

相互依存の循環 「投資」の実態

表面上はAmazonがAnthropicに出資する形ですが、契約の実態は双方向のコミットメントです。Anthropicは今後10年間でAWSに1,000億ドル超(約15.9兆円)を支出することを約束しており、受け取った資金の多くがAWSのインフラ・チップへ再投資される循環構造になっています。

いわば「AmazonがAnthropicに資金を渡し、AnthropicがAmazonのサービスに使う」という構造であり、単純な出資関係ではなくエコシステム統合のための長期コミットメントといえます。

主体 | 得るもの |

|---|---|

Amazon | AWS上の強力なAIモデルの確保、自社チップ(Trainium)の大口顧客獲得、AWSのAI競争力強化 |

Anthropic | 巨額の開発資金、NVIDIA依存からの脱却、10万社超のAWS顧客へのアクセス、安定したインフラ基盤 |

さらにAnthropicは2026年4月6日にGoogleとのTPU大規模調達パートナーシップも締結しており、AWS・Google Cloud・Azureの三大クラウド全てでClaudeを展開できる唯一の最先端AIモデルという立場を確立しつつあります。競合他社と比較したとき、Claudeのマルチクラウド展開能力は、調達先の柔軟性を求めるエンタープライズ顧客にとって大きな訴求点となります。

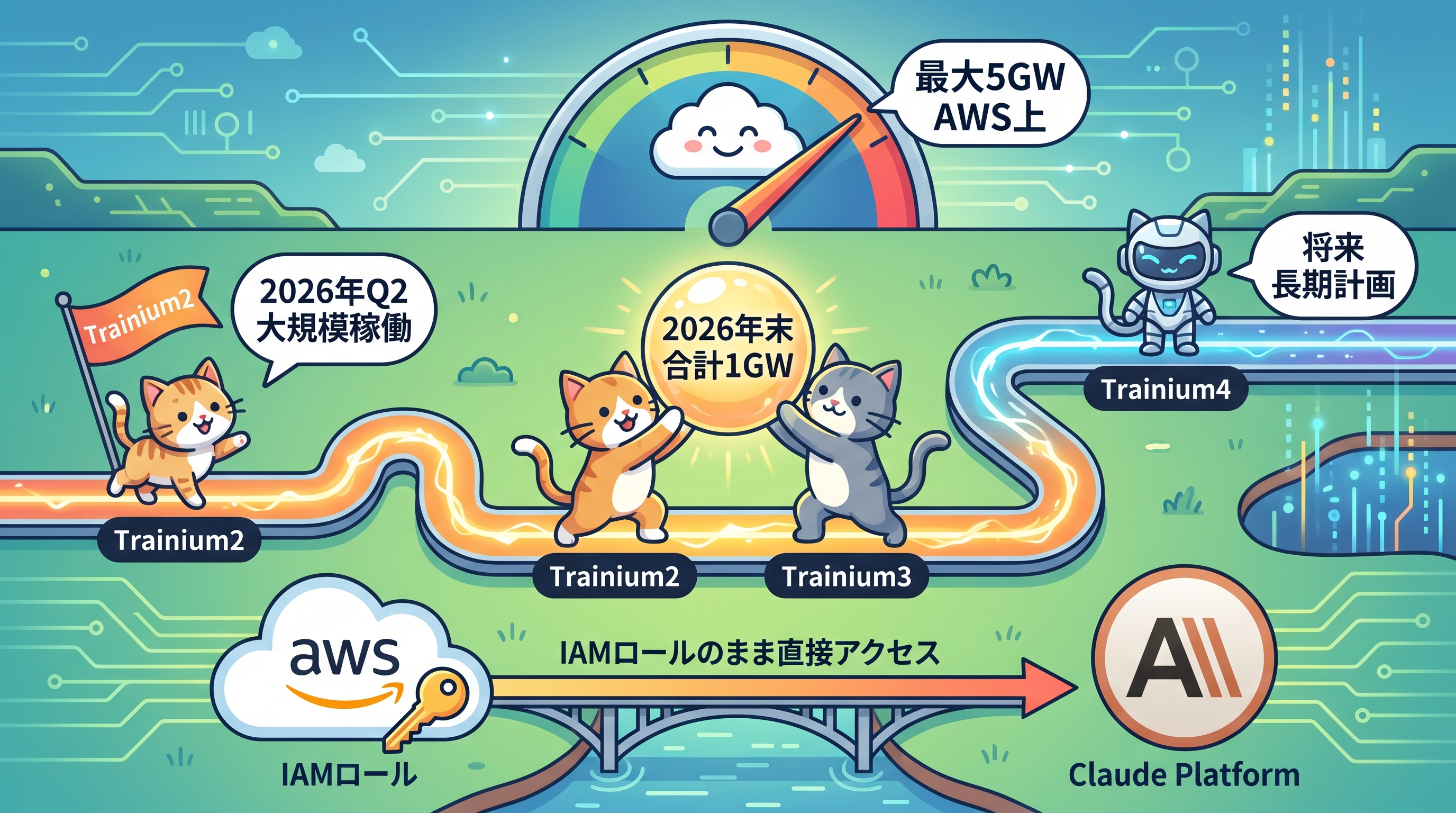

Trainium世代ロードマップ エンジニアが知るべきチップ戦略

Anthropicは今回の契約で、Amazon独自開発チップを中心としたインフラ戦略を明確にしました。Claudeのトレーニングと運用に最大5GWのコンピューティング容量をAWS上で確保し、チップの世代移行も長期にわたって計画されています。

スケジュール | 内容 |

|---|---|

2026年Q2 | Trainium2の大規模稼働開始 |

2026年末 | Trainium2 + Trainium3 合計 約1GW稼働予定 |

将来 | Trainium4世代まで含む長期コミットメント、数千万個のGraviton CPUコアも活用 |

アジアおよびヨーロッパでの推論能力拡大も計画に含まれており、グローバルな低レイテンシ推論への布石となっています。これはAsia-Pacific(東京・シンガポール等)リージョンでAWSを使う日本企業にとっても、将来的なClaude APIのレスポンスタイム改善につながる動きとして注目に値します。

NVIDIA GPUへの依存度を下げることは、GPU供給不足によるインフラコストの上昇リスクを軽減することも意味します。Trainium世代の大規模展開が実現すれば、推論コストの抑制にも波及する可能性があり、API利用料金へのプラスの影響が期待されます。

AWS利用企業への実務的影響 APIアクセスの変化

今回の提携で最もエンジニアに直結する変化が、AWSアカウントとClaude Platformの統合です。AWS利用企業は既存のAWSアカウントのまま、追加契約や認証手続きなしにAnthropicネイティブの Claude Platformへ直接アクセスできるようになります。

これまでAnthropicのAPIを使うには、Anthropic Consoleへの個別登録とAPIキーの管理が必要でした。AWSアカウントとの統合が実現すれば、IAMロールベースのアクセス制御やAWSの請求一元化の恩恵を受けながらClaudeを使えるようになります。セキュリティポリシーやコスト管理の観点から、エンタープライズ導入のハードルが大きく下がることが見込まれます。

また、Amazon BedrockでもClaudeの全機能が利用可能になる予定です。現在Bedrockを経由してClaudeを使っているチームにとっては、APIのバージョン管理や機能差異に悩む場面が減ることが期待されます。Anthropic APIとBedrock APIの間にあった機能ギャップが解消されれば、ベンダー選択の観点も含めて設計をシンプルにできます。

インフラ投資の増強はAnthropicのAPIキャパシティ拡大にも直結します。Claudeの年換算売上高は2025年末の90億ドルから直近で300億ドル超へ急増しており、需要に対してインフラが追いついていないことが今回の大規模投資の直接的な動機となっています。今後はスロットリングや高負荷時のレイテンシ悪化が改善されることが見込まれます。

エンジニアとしての戦略的示唆

この提携がエンジニアリング判断に与える影響を整理します。短期・中長期の両面で、技術選定の前提が変わりつつあります。

観点 | 示唆 |

|---|---|

APIの信頼性 | 大規模インフラ投資によりキャパシティが拡充。レイテンシ・可用性の改善が期待できます |

AWSとの統合 | 既存のIAMロールや請求管理の延長線上でClaudeを利用できる見通し。マルチサービス構成がシンプルになります |

チップ依存リスク | NVIDIA GPU依存から独自チップ(Trainium/TPU)への分散が進み、供給面のリスクが低下します |

モデル選択戦略 | AWS/Google Cloud/Azureすべてでフルスタックに使えるモデルが限られる中、Claudeの調達先選択肢が広がります |

コスト予測 | Trainium展開によるコスト低下効果が中長期で推論料金に波及する可能性があります |

一方で注意点もあります。AWSへの深いロックインが進むため、将来的にマルチクラウド構成でClaudeを使う場合のコスト構造やAPIの挙動差異は継続してウォッチが必要です。また、Googleとのシリコンパートナーシップとの優先度付けが今後どう変化するかも、技術戦略を立てる上で確認しておきたい点です。

Bedrockを通じたアクセスかAnthropicネイティブAPIかという選択も、今後の機能統合の進み具合によっては再考が必要になる場面が出てくるかもしれません。アーキテクチャ設計の段階から、どちらのエンドポイントを正とするか方針を持っておくと、後の移行コストを下げられます。

Anthropicを中心に据えたAI開発・運用を検討しているチームにとっては、今が最もコストパフォーマンスよくスケールできるタイミングになる可能性があります。公式発表とAWSのアップデートをこまめに追いながら、自社システムへの組み込み計画を具体化するとよいでしょう。AWSのBlogs・What's New、AnthropicのChangelogを定期的にチェックすることをおすすめします。